Монетизация чужого контнета.

Суббота, 8-Июль-2023.

По-сообщению Silicon Republic, 1 июля текущего года google обновил свою политики конфиденциальности. В ней он заявил о своём намерении собирать в интернет любую публично доступную информацию, в том числе, в некоторых случаях, информацию личного характера в качестве учебного материала для модели искусственного интеллекта (далее: ИИ) и развития некоторых сервисов/продуктов, в том числе чат-бота под названием Bard.

Ровно то же самое и с аналогичной целью месяцами ранее проделала негласно компания OpenAI. Против попрания воли/интересов пользователей не выступили ни защитники авторских прав, в прошлом наводившие кошмар на пиратов и уничтожившие ряд пиринговых сетей; ни правозащитники; ни прочие "защитники гражданских прав в цифровом мире".

Поэтому, для предотвращения эксплуатации моего контента воротилами бизнеса, опираясь на спецификацию RFC 9309, я запретил всем нежелательным ботам обращаться к моему web блогу. К числу нежелательных я отнёс каждого бота, чья польза не очевидна или чьё описание недоступно. Практически это означает (или должно означать) исключение моего блога из поисковой выдачи некоторых ведущих поисковых сервисов в интернет.

Прежде, чем я успел поставить последнюю точку в предыдущем абзаце, моё внимание привлекла новость, опубликованная известным американским криптографом и автором книг по информационной безопасности Брюсом Шнайером. Изложенные им факты раскрывают ущербную сторону ИИ перед человеком, которая выражается в неспособности моделей ИИ рекурсивно обучать себе подобных. ИИ может развиваться только за счёт использования сетевого контента. Качественного контента на современных языках, представленного плодами бескорыстного эпистолярного творчества людей. Цитирую мистера Шнайера в моём вольном переводе на русский язык:

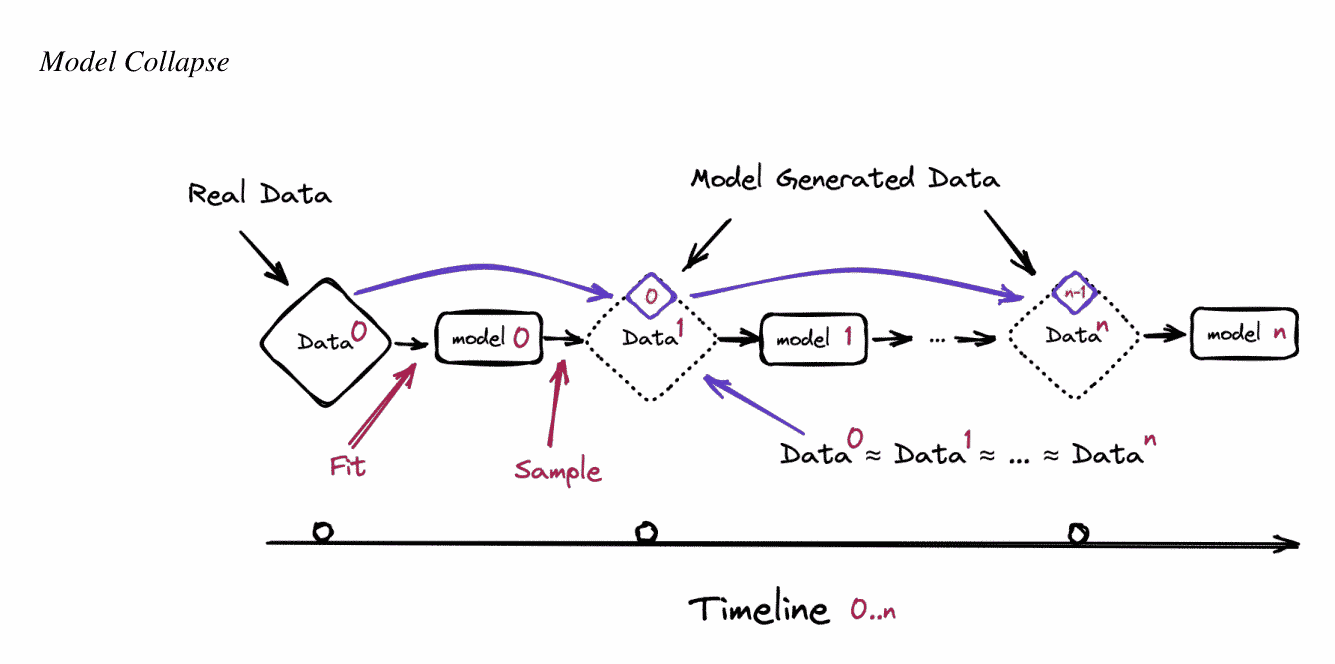

Последнее исследование показало, что составленный ИИ текст является непригодным для обучения следующей модели ИИ, так как неизменно вызывает "необратимые дефекты". Учебный материал деградирует от модели к модели, поскольку Гауссовы распределения сходятся в одну точку и могут даже стать дельта-функциями. Мы называем этот эффект коллапсом модели ИИ.

Последнее исследование показало, что составленный ИИ текст является непригодным для обучения следующей модели ИИ, так как неизменно вызывает "необратимые дефекты". Учебный материал деградирует от модели к модели, поскольку Гауссовы распределения сходятся в одну точку и могут даже стать дельта-функциями. Мы называем этот эффект коллапсом модели ИИ.

В последнее время проблема усугубляется снижением качества сетевого контента потому, что люди наполняют интернет вздором подобно тому, как засоряют океан пластиковым мусором и насыщают атмосферу углекислым газом. Это затрудняет обучение каждой последующей модели ИИ и обуславливает преимущество для фирм, которые уже успели обучить ИИ. Вот почему мы наблюдаем сегодня мощный всплеск обращений к архиву интернет за учебным материалом со стороны компаний, сосредоточенных на разработке ИИ.

Ровно это же высказал Тед Чанг, но другими словами: ChatGPT - это "размазанное графическое изображение всего текста в интернет". Данное утверждение имеет математическое доказательство.

Это означает, что текст, датированный периодом времени до 2023 года, гарантированно составлен человеком, и он будет неумолимо расти в цене.

Конец цитаты. Для желающих глубже погрузиться в тему коллапса моделей ИИ доступна работа кандидата наук, доцента университета Пуатье Эндрю Петерсона.

Не кажется-ли Вам формой паразитирования практика воротил бизнеса обучать ИИ на бесплатном сетевом контенте для личного обогащения?

#2023, #сеть, #сша, #капитализм, #преступление, #цинизм, #блог